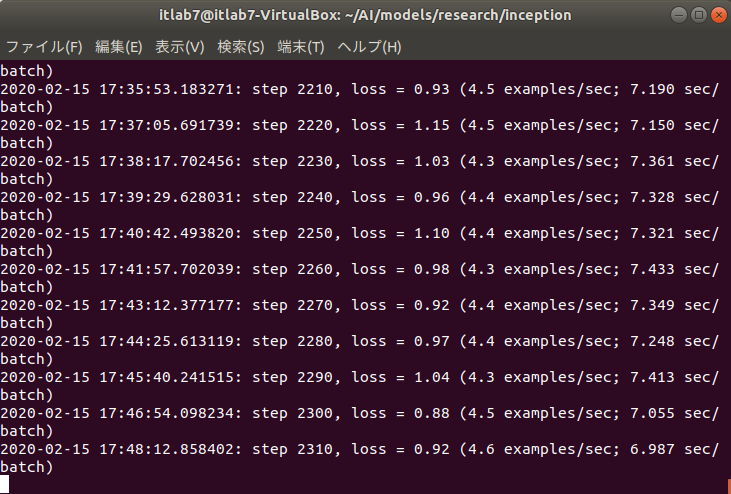

前回でinceptionの訓練処理までを行いました。 というか、訓練開始から5時間たちましたが、まだ完了していません。 しかし、step数は2310まで行きましたので、途中ですが いつ終わるか分かりませんので、現状のモデルで評価処理を行いたいと思います。公式サイトによると、2000stepでも93.4%の精度となるようです。

/tmp/flowers-data ディレクトリと/tmp/flowers_train ディレクトリは/tmpにあるとUbuntuの起動時に消えてしまいますので、~/AI/inception ディレクトリへコピーしておきました。

/tmp/flowers-data ディレクトリと/tmp/flowers_train ディレクトリは/tmpにあるとUbuntuの起動時に消えてしまいますので、~/AI/inception ディレクトリへコピーしておきました。

新しい端末を起動して、inceptionのディレクトリに移動します。

cd ~/AI/models/research/inception/

評価処理を行うプログラムをビルドします。

bazel build //inception:flowers_eval

ビルド完了しました。

ビルド完了しました。

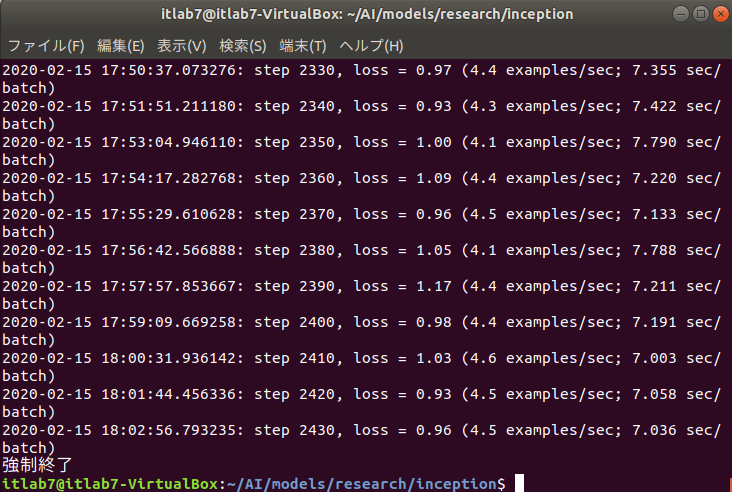

ここで、訓練処理をしていた端末の方で訓練処理が強制終了していました。

訓練処理をしながら評価処理をするのは無理なのかもしれません。

ここで、訓練処理をしていた端末の方で訓練処理が強制終了していました。

訓練処理をしながら評価処理をするのは無理なのかもしれません。

評価処理を実行します。

bazel-bin/inception/flowers_eval \ --eval_dir="/tmp/flowers_eval/" \ --data_dir="/tmp/flowers-data/" \ --subset=validation \ --num_examples=500 \ --checkpoint_dir="/tmp/flowers_train/" \ --input_queue_memory_factor=1 \ --run_once

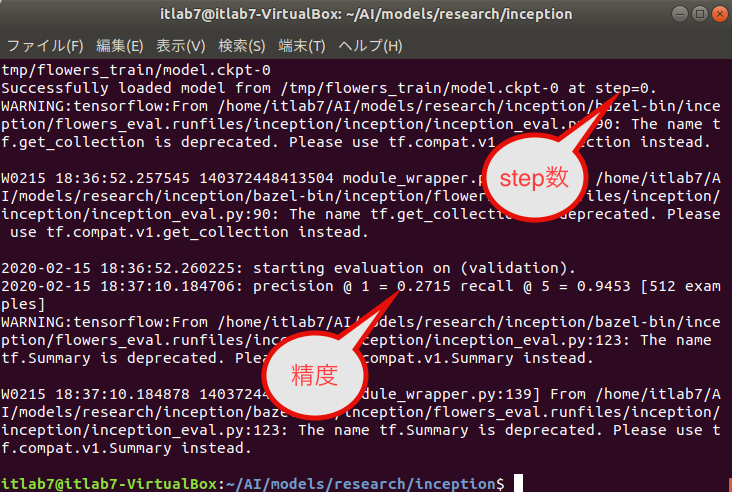

評価処理は完了しました。 しかし、これは上手くいっていないようです。step数は0、精度は27%になっています。 やはり、訓練処理が最後まで実行されていないのが良くないものと思われます。

残念ながら、今回は失敗です。 次回は、時間がかかりすぎるので、step数を減らして実行できないか調べてみます。